В Google «с высокой уверенностью» выявили применение злоумышленниками ИИ-модели для создания первого известного способа обхода двухфакторной аутентификации (2FA) с использованием уязвимости «нулевого дня».

В компании отметили, что речь идет о «веб-инструменте системного администрирования с открытым исходным кодом».

Специалисты выдвинули такую гипотезу, поскольку скрипт для эксплоита включал генерацию недостоверных данных и формат, «в высшей степени характерный» для обучающих данных модели ИИ.

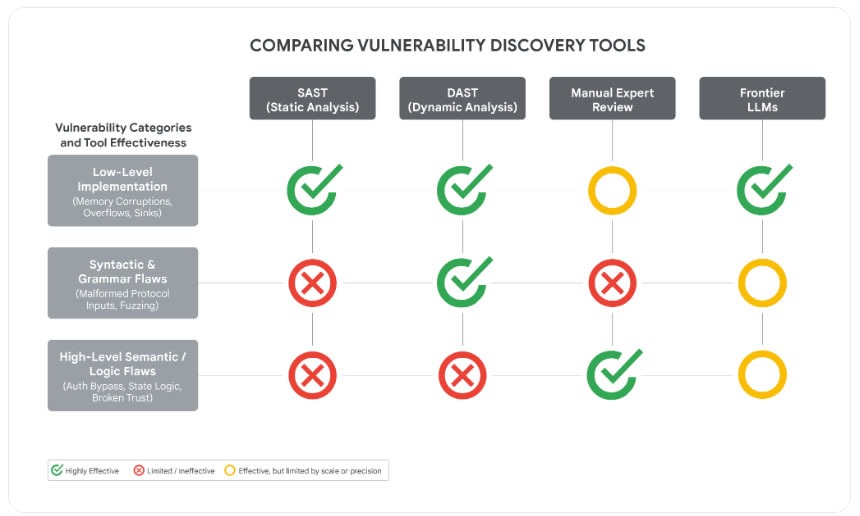

Данная уязвимость не была вызвана «типичными ошибками реализации», такими как нарушения целостности памяти, а являлась «семантическим логическим недостатком высокого уровня», в котором разработчик жестко запрограммировал допущение о доверии.

Это означает, что злоумышленники использовали передовую большую языковую модель (LLM). Последние хорошо справляются с выявлением высокоуровневых недостатков и «жестко запрограммированных статических аномалий».

Уязвимость позволяла обойти 2FA, которая часто применяется для защиты аккаунтов на биржах и кошельков, при наличии действительных учетных данных.

В отчете не указано, кто именно стоял за этой угрозой.

Рост применения ИИ

ИИ все чаще используется как в сфере кибербезопасности, так и криптовалютными хакерами, стремящимися осуществлять атаки или мошенничество.

В апреле в Anthropic заявили, что ее модель Claude Mythos, обнаружила тысячи уязвимостей в ПО крупных систем.

Злоупотребление доступом к LLM переходит на промышленный уровень: злоумышленники создали автоматизированные конвейеры для циклического использования премиум-аккаунтов ИИ, объединения ключей API и обхода защитных барьеров в больших масштабах. Фактически они осуществляют злонамеренные операции за счет пробных учетных записей.