Nvidia выпустила Nemotron 3 Super — модель со 120 млрд параметров для автономных ИИ-агентов — и раскрыла планы вложить $26 млрд в развитие открытого ИИ на горизонте пяти лет.

Открытый ИИ — это модели с публично доступными весами: любой разработчик может скачать такую модель, запустить на собственном оборудовании и адаптировать под свои задачи, не завися от стороннего сервиса. Это принципиально отличает их от закрытых решений вроде GPT-4 или Claude, доступных только через API.

За этим шагом стоит конкретная инженерная проблема. Многоагентные системы генерируют в разы больше токенов, чем обычный чат: каждый вызов инструмента, каждый шаг рассуждения и каждый фрагмент контекста отправляются заново с нуля. Затраты растут лавинообразно, модели начинают «дрейфовать», а агенты постепенно теряют точность.

Архитектура: три компонента в одном

Модель активирует лишь 12 млрд из 120 млрд параметров одновременно — благодаря архитектуре Mixture-of-Experts (MoE). Контекстное окно в 1 млн токенов позволяет агентам держать в памяти целую кодовую базу — около 750 тысяч слов — без потери связности.

Nvidia объединила в одной архитектуре три компонента: слои Mamba-2 для эффективной обработки длинных последовательностей, слои Transformer для точного извлечения информации и механизм Latent MoE, который активирует вчетверо больше специалистов при тех же вычислительных затратах.

Модель обучалась в 4-битном формате NVFP4 с первого шага. Обычный подход иной: сначала обучение в высокой точности, затем сжатие — нередко в ущерб качеству рассуждений. Nemotron 3 Super изначально учится работать в условиях низкой точности, а не адаптируется к ним постфактум.

Производительность и открытость

По сравнению с предшественником модель обеспечивает более чем пятикратный рост пропускной способности. В сравнении с конкурентами: Nemotron 3 Super в 2,2 раза быстрее GPT-OSS 120B от OpenAI и в 7,5 раза быстрее Qwen3.5-122B от Alibaba. Веса опубликованы на Hugging Face, методология обучения полностью открыта. Perplexity, Palantir, Cadence и Siemens уже интегрируют модель в свои рабочие процессы.

$26 млрд и геополитика открытого ИИ

Согласно финансовой отчётности за 2025 год, Nvidia направит $26 млрд на разработку открытых моделей в течение пяти лет. Логика прозрачна: чипы Nvidia остаются стандартной инфраструктурой для обучения моделей, а решения, оптимизированные под её архитектуру, удерживают клиентов в экосистеме компании.

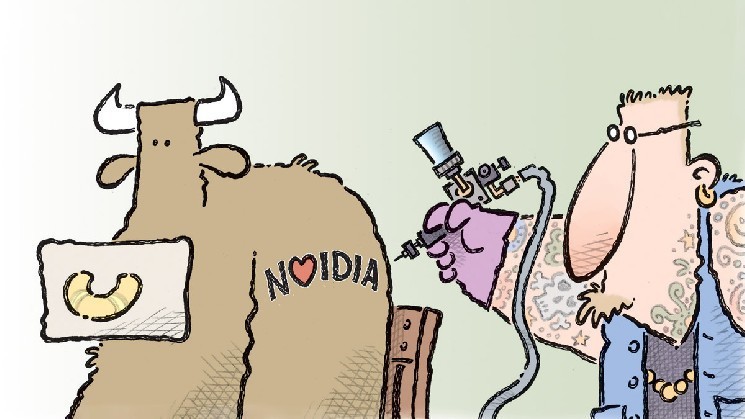

Доля китайских открытых моделей в глобальном использовании выросла с 1,2% в конце 2024 года до около 30% к концу 2025-го. Qwen от Alibaba обошёл Llama от Meta как наиболее используемая self-hosted модель. Пока OpenAI, Anthropic и Google держат лучшие модели за закрытыми API, китайские лаборатории активно заполняют открытую экосистему. Выпуск Nemotron 3 Super и $26 млрд инвестиций — ответ Nvidia на этот вызов.

Мнение ИИ

Nvidia фактически субсидирует конкурентов своих главных клиентов — OpenAI, Anthropic, Google. Каждый разработчик, который получит бесплатную мощную модель и развернет её на чужом железе, становится потенциальным покупателем чипов Nvidia. Компания не строит второй бизнес — она строит воронку для первого.

hashtelegraph.com

hashtelegraph.com