La SEC ha anunciado planes para integrar tecnología de inteligencia artificial con el fin de facilitar y agilizar la detección de anomalías y realizar evaluaciones de riesgos.

La SEC está persiguiendo los malos actores que explotan la tecnología de IA con fines fraudulentos y a las empresas que se dedican al lavado de activos de IA para engañar a los inversores.

¿Cómo utiliza la SEC la IA para proteger a los inversores y atrapar a los estafadores?

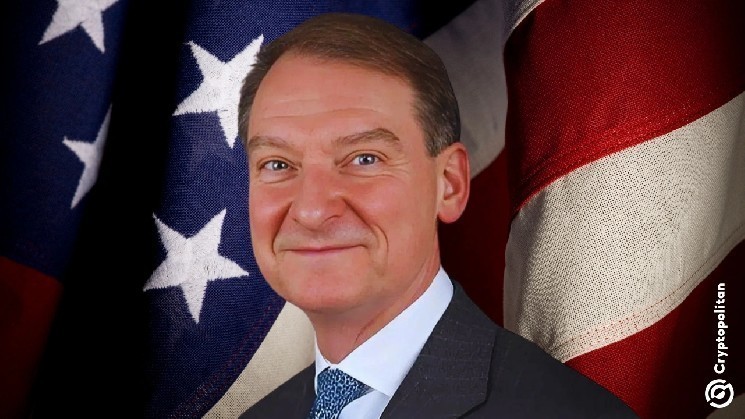

La Comisión de Bolsa y Valores (SEC), bajo el liderazgo de su presidente, Paul S. Atkins, está implementando una estrategia para combatir la IA con IA. La iniciativa se centra en el Grupo de Trabajo sobre IA de la SEC , creado para brindar a toda la agencia acceso a los avances tecnológicos y garantizar que la comisión se mantenga al día con la rápida evolución del sector financiero privado.

La Comisión utiliza algoritmos para detectar prácticas fraudulentas en el mercado, como fraudes y maniobras comerciales manipuladoras. Estas herramientas pueden detectar anomalías en el volumen de negociación o en las fluctuaciones de precios con mayor rapidez y precisión que los métodos tradicionales.

La IA también ayuda al personal de la agencia adentomisiones materiales o declaraciones engañosas en documentos presentados por miles de empresas públicas de manera más eficiente, lo que permite a la SEC reaccionar a los aportes del público y a los cambios del mercado en tiempo real.

El presidente Atkins ha señalado que el objetivo de la SEC sigue siendo proteger a los inversores, independientemente de las herramientas que utilice. En esta ocasión, la agencia está buscando específicamente indicios de "lavado de activos con inteligencia artificial". Este término se utiliza para describir a las empresas que hacen afirmaciones falsas, exageradas o engañosas sobre el uso de inteligencia artificial para impulsar el precio de sus acciones o trac inversores.

¿Cuáles son los riesgos de utilizar IA en la regulación gubernamental?

Una de las principales preocupaciones con respecto a la IA en el gobierno es la posibilidad de una toma de decisiones de caja negra, donde un algoritmo toma una decisión sin una razón clara y comprensible para los humanos. El presidente Atkins aclaró que la interacción humana es necesaria en cada etapa del programa de evaluación de riesgos de la SEC.

“El debido proceso lo exige”, señaló Atkins durante una reciente mesa redonda del Consejo de Supervisión de la Estabilidad Financiera (FSOC). Un algoritmo podríadentun patrón sospechoso o una anomalía, pero carece de la capacidad de determinar la credibilidad de un testigo o evaluar la intención de un participante del mercado. En consecuencia, la decisión final recae en los comisionados y el personal profesional.

Desarrolladores líderes de IA, como Google (Gemini), OpenAI y Anthropic, han publicado previamente informes que detallan cómo entidades maliciosas explotan sus plataformas. Por ejemplo, OpenAI informó recientemente sobre la interrupción de actores de amenazas estatales que utilizaban IA para investigar vulnerabilidades y generar contenido de phishing. De igual manera, el Grupo de Análisis de Amenazas de Google ha trac el uso de Modelos de Lenguaje Grandes (LLM) en ataques de ingeniería social diseñados para robar credenciales dent .

La SEC obligará a las empresas a revelar información relacionada con la IA si existe una probabilidad sustancial de que un accionista razonable la considere importante para una decisión de inversión.

A principios de 2024, la Comisión resolvió los cargos contra dos asesores de inversión por realizar declaraciones falsas y engañosas sobre el uso de la IA. En esos casos, las empresas afirmaron usar la IA para analizar millones de datos y predecir las fluctuaciones del mercado, pero la SEC determinó que dichas afirmaciones eran falsas.